Capas de Activación en CNN: Espiando el Cerebro de tu Red Neuronal

Descubre cómo estas capas revelan si tu modelo está aprendiendo o solo viendo ruido

¡Atención, genio del deep learning! Hoy te voy a desglosar uno de esos temas que parecen complicados pero que, cuando los entiendes, dices: "Ahhh, claro, ahora todo tiene sentido". Hablemos de las capas de activación en las Redes Neuronales Convolucionales (CNN). Porque sí, esas mismas que hacen magia con las imágenes y que tú seguro quieres dominar.

Las capas de activación: ¿Qué narices son?

Imagínate que cada vez que procesas una imagen, tu red neuronal es como un fotógrafo que pasa por filtros. Pero no filtros de Instagram, ojo, sino unos que te dicen cosas como: "¡Eh, aquí hay un borde!", "Esto parece una textura", o "¿Será esto una nariz?". Cada capa en una CNN tiene su propia misión en este festival de análisis: desde identificar lo básico (bordes, puntos) hasta entender si lo que tiene delante es un perro, un gato o un pato con sombrero.

Lo bueno de las CNN es que estos filtros no los defines tú. Ellas solitas los aprenden mientras entrenan. Tú solo les dices: "Esto es un perro", "Esto es un gato", y la red hace su magia para detectar patrones que le permitan distinguirlos.

¿Por qué te importa lo que hacen las capas?

Porque estas capas te dicen si tu red está trabajando como se debe o si está jugando al despiste. ¿Te imaginas gastar horas de entrenamiento solo para descubrir que la red ha aprendido a distinguir imágenes por algo absurdo como el color de fondo? Pues pasa. Y pasa más de lo que debería.

Por eso necesitas echar un ojo a las activaciones intermedias. Es como mirar el cuaderno de apuntes de un estudiante para saber si está aprendiendo algo útil o si solo dibuja monigotes.

Cosas que puedes averiguar revisando estas capas:

¿Está aprendiendo lo correcto?

Al principio de la red, ves bordes y texturas. Más adelante, aparecen formas y, con suerte, patrones que parecen partes de objetos. Si todo parece ruido o formas raras, spoiler alert: algo va mal.Diagnosticar problemas de entrenamiento.

Si en una capa todo son ceros o valores máximos, tu red tiene un problema. Es como cuando intentas encender un coche y no suena nada: algo no conecta.Evaluar la calidad de los patrones.

¿Está viendo lo esencial o se ha obsesionado con detalles irrelevantes? Las activaciones te ayudan a saber si el motor de tu CNN está bien afinado o si necesita un ajuste.

¿Cómo puedes analizar estas capas?

Tranquilo, que no necesitas ser un ingeniero de la NASA. Con librerías como PyTorch, TensorFlow o Keras, extraer las activaciones es tan fácil como pasar una imagen y decirle a la red: "Enséñame lo que ves aquí".

Pasos básicos:

Escoge las capas a observar. Decide si quieres mirar las primeras (básicas) o las últimas (las de alto nivel).

Propaga la imagen. Pasa una imagen por la red y captura las salidas intermedias.

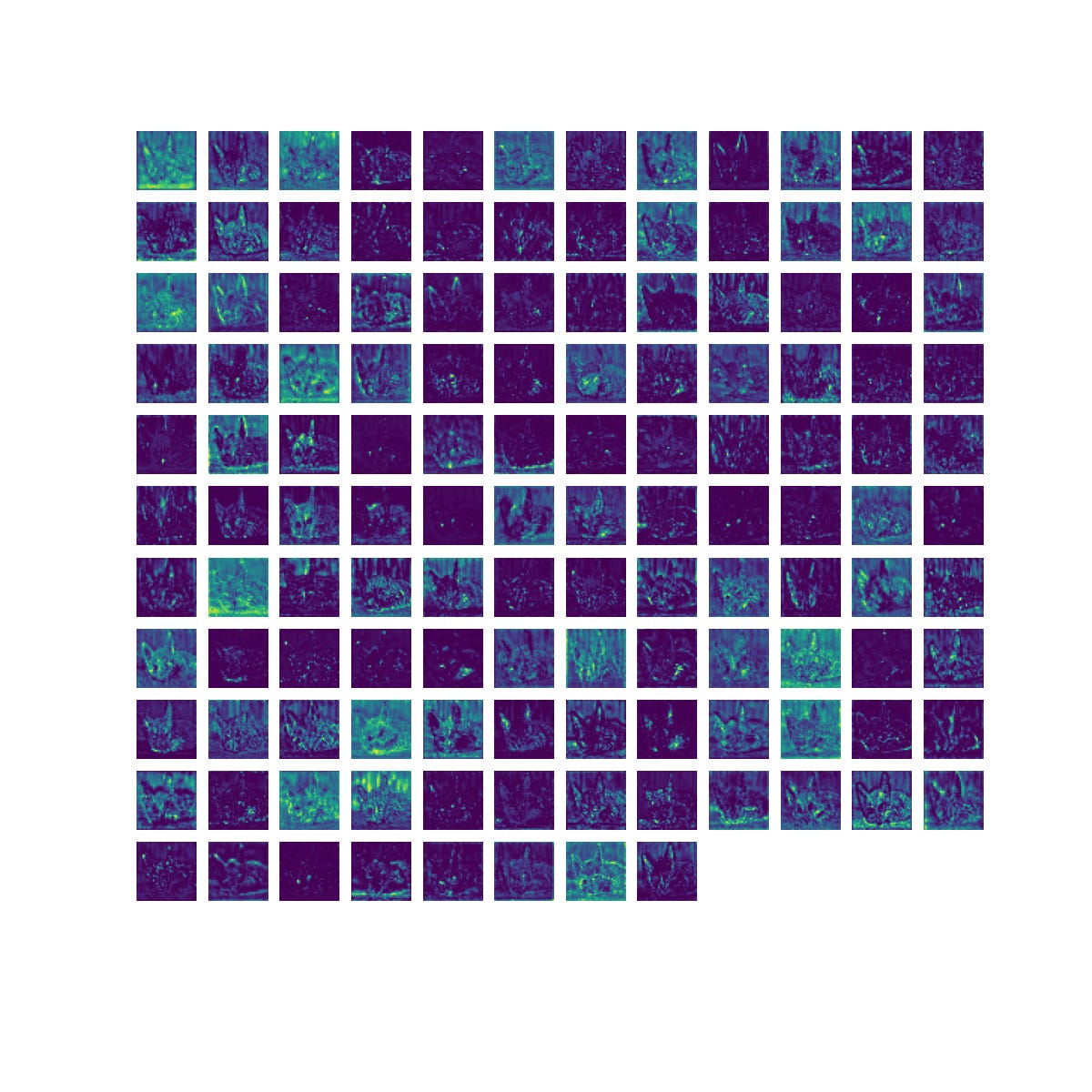

Visualiza el resultado. Usa gráficas, histogramas o imágenes. Así te das cuenta de si tu red está viendo patrones útiles o si está más perdida que un pulpo en un garaje.

Implementación Práctica: Descubre cómo aplicar estos conceptos

Ahora que comprendes la importancia de las capas de activación y cómo pueden ser utilizadas para evaluar el aprendizaje de tu modelo, vamos a mostrarte cómo implementarlo paso a paso utilizando YOLO de Ultralytics. La clave está en tres elementos: cargar el backbone del modelo, preprocesar las imágenes y visualizar las activaciones.